Pokud se v posledních letech zajímáte o umělou inteligenci, pravděpodobně jste se setkali s velkými jazykovými modely (LLM) jako ChatGPT, Claude nebo Gemini. Tyto modely se staly synonymem pro AI v očích veřejnosti, ale realita je mnohem pestřejší a fascinující. Svět umělé inteligence nabízí širokou rodinu specializovaných AI modelů a architektur, z nichž každý řeší specifické úkoly svým způsobem.

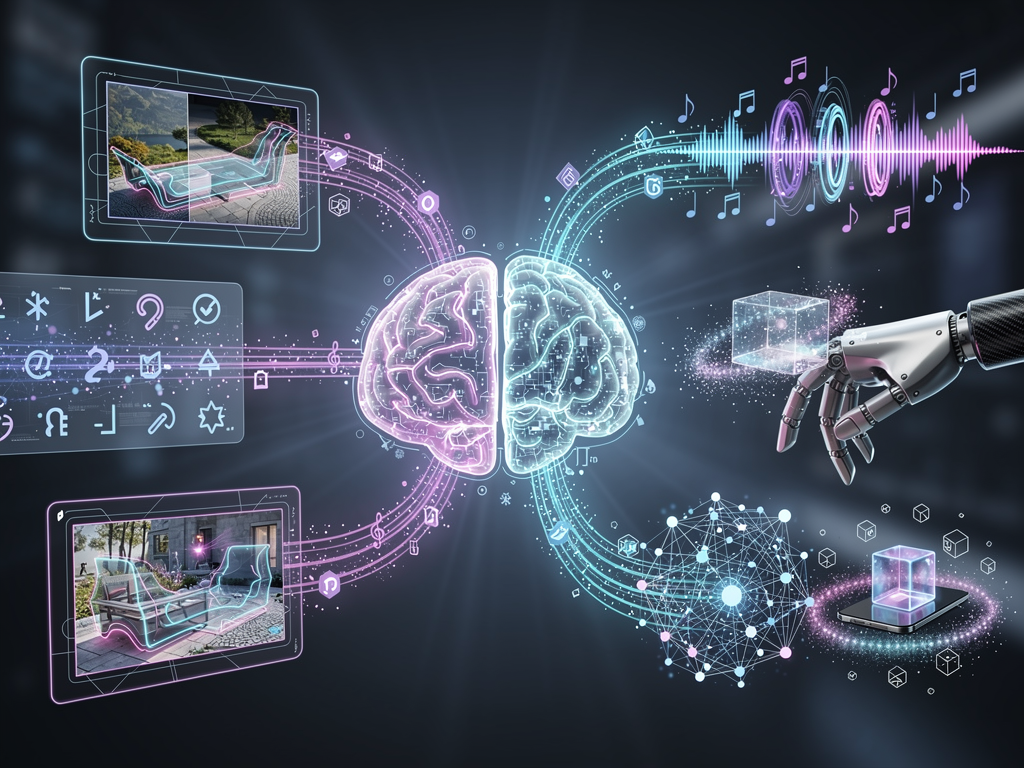

Dnes se zaměříme na některé typy neuronových modelů a architektur, které vznikly teprve v posledních letech a představují špičku současného výzkumu. Od multimodálních modelů zpracovávajících text a obrázky, přes neuronové sítě analyzující složité vztahy, až po audio modely rozpoznávající řeč a generující hudbu. Objevte s námi, proč jen LLM zdaleka nestačí.

Proč nestačí jen LLM?

Představte si, že byste na všechny úkoly používali pouze kladivo. Možná by to fungovalo, ale šroubovák by byl na šrouby určitě vhodnější. Podobně je to s AI modely. Zatímco LLM skvěle zvládají práci s textem, generování odpovědí nebo kódu a obecné konverzace, existují úkoly, které vyžadují zcela odlišný přístup.

Tradiční decoder-only LLM fungují na principu Transformer architektury s jednosměrnou pozorností. Model čte vstupní text zleva doprava a pomocí pozornostního mechanismu se může dívat pouze na předchozí tokeny. Díky tomu efektivně generuje souvislý text token po tokenu.

Tento přístup je extrémně efektivní pro sekvenční generování textu, ale má svá omezení. Model má omezenou „paměť“, neboli kontextové okno, a nemůže si zapamatovat nekonečně dlouhý text. Také musí slova (tokeny) generovat jedno za druhým, což je pomalé. U některých typů modelů navíc nevidí dopředu, což je problém například při potřebě generovat přesně dlouhý text, kde je užitečné znát celou větu předem.

Rozmanitost AI modelů: Překračujeme hranice textu

Multimodální modely: Když text nestačí

Jedním z největších průlomů posledních let jsou VLM (Vision-Language Models). Tyto multimodální modely dokážou současně zpracovávat obrázky a text, což otevírá úplně nové možnosti. Místo popisování obrázku slovy může model přímo analyzovat fotografii a odpovědět na otázky o jejím obsahu.

Prakticky to znamená, že můžete nahrát fotku jídla a zeptat se na recept, ukázat modelu diagram a nechat si ho vysvětlit, nebo poslat snímek obrazovky s chybovou hláškou a požádat o pomoc. VLM spojují vizuální vnímání s jazykovým porozuměním způsobem, který se blíží lidskému uvažování.

Specializace pro konkrétní úkoly

Zatímco LLM jsou jako švýcarské nožíky AI světa, některé úkoly vyžadují vysoce specializované nástroje. Například SAM (Segment Anything Model) je model od společnosti Meta navržený výhradně pro rozpoznávání a oddělování objektů v obrazech. Dokáže s neuvěřitelnou přesností identifikovat hranice předmětů, lidí nebo oblastí na fotografii.

Podobně fungují difuzní modely určené pro generování obrázků, hudby nebo videa. Modely jako Stable Diffusion nebo DALL-E 3 kombinují princip postupného odšumování s klíčovými komponentami Transformer architektury. Pracují s postupným odstraňováním šumu z náhodného signálu, přičemž textový kodér zpracovává výzvu a U-Net architektura pro odšumování používá mechanismy křížové pozornosti z Transformerů, aby „porozuměla“, jak má obrázek vypadat podle textového popisu.

Efektivita a rychlost: Malí, ale šikovní

Neméně důležité jsou SLM (Small Language Models), menší verze velkých jazykových modelů. Tyto kompaktní verze obětují část schopností výměnou za rychlost a nižší nároky na výpočetní výkon. Jsou ideální pro mobilní aplikace, embedded systémy nebo situace, kde potřebujete okamžitou odpověď.

SLM dosahují efektivity několika způsoby, například kvantizací, která snižuje přesnost čísel, nebo destilací znalostí, jež umožňuje menšímu modelu naučit se chování velkého modelu. Moderní SLM jako Phi-3 nebo Gemma využívají také architektonické inovace jako seskupenou pozornost dotazů. SLM dokážou běžet přímo ve vašem telefonu nebo tabletu, aniž by potřebovaly připojení k internetu.

Když je potřeba extra výkon: Experti v akci

Na opačném konci spektra najdeme MoE (Mixture of Experts) modely. Tyto sofistikované systémy obsahují desítky či stovky specializovaných „expertních“ sítí, přičemž pro každý konkrétní dotaz aktivují pouze ty nejvhodnější. Výsledkem je obrovský výkon při relativně rozumné spotřebě zdrojů.

MoE architektura zahrnuje směrovací síť, která rozhoduje, kteří experti budou aktivováni pro daný token. Typicky se aktivuje pouze malé procento všech expertů, což znamená, že model může mít biliony parametrů, ale pro jeden dopředný průchod použije jen zlomek z nich. Příkladem je Mixtral 8x7B nebo pravděpodobně i GPT-4.

Encoder-Decoder modely: Nejlepší z obou světů

Mezi decoder-only LLM a encoder-only MLM existuje třetí pilíř Transformer architektury: Encoder-Decoder modely jako T5 nebo BART. Tyto modely kombinují silné stránky obou přístupů. Encoder část využívá bidirekcionální pozornost pro hluboké porozumění vstupnímu textu, zatímco decoder část generuje výstup autoregresivně. Tato architektura je extrémně účinná pro úkoly jako strojový překlad nebo sumarizace textu.

Grafové neuronové sítě: Když záleží na vztazích

Graph Neural Networks (GNN) představují zcela odlišný přístup k umělé inteligenci, který se zaměřuje na data strukturovaná jako grafy. Zatímco LLM pracují se sekvencemi a VLM s obrazy, GNN zpracovávají entity a vztahy mezi nimi.

GNN jsou nepostradatelné v oblastech, kde jsou relace mezi objekty klíčové. V sociálních sítích analyzují vztahy mezi uživateli pro doporučovací systémy. V chemii pomáhají porozumět struktuře molekul pro vývoj léků. V dopravě optimalizují trasy v silničních sítích.

Světové modely: Učení pozorováním reality

Zcela odlišný přístup představují světové modely (World Models), které se učí pozorováním fyzického světa místo čtení textů. Nejznámějším příkladem je V-JEPA (Video Joint-Embedding Predictive Architecture) od společnosti Meta. Model pozoruje, jak se objekty pohybují, jak reagují na síly a jak spolu interagují, a postupně si tak buduje vnitřní představu o tom, jak fyzický svět funguje.

Audio modely: Zvuk jako další modalita

Zpracování zvuku představuje další důležitou oblast AI. Audio modely se dělí do několika kategorií:

- Speech-to-Text modely jako Whisper od OpenAI dokážou převést mluvenou řeč na text s překvapivou přesností.

- Text-to-Speech modely generují lidsky znějící hlas z textového vstupu.

- Generativní zvukové modely jako MusicGen od Meta dokážou vytvářet hudbu na základě textových popisů.

Logické uvažování a symbolické zpracování

LAM (Logic-Augmented Models) představují zajímavý hybrid neurálních sítí a symbolické umělé inteligence. Tyto modely kombinují schopnost neuronových sítí učit se z dat s přesností formální logiky. Používají externí důvodové motory pro řešení komplexních logických problémů, které jsou pro čisté neuronové sítě obtížné.

Latentní konsistence a strukturované generování

LCM (Latent Consistency Models) představují pokročilý přístup k generativním úkolům. Místo tradičního rozptylovacího procesu používají trénování konzistence ve skrytém prostoru. To umožňuje dramaticky rychlejší generování než tradiční difuzní modely, protože eliminuje potřebu iterativního procesu odšumování.

Masked Language Models a bidirekční porozumění

MLM (Masked Language Models) jako BERT používají fundamentálně odlišný přístup než autoregressive LLM. Místo generování textu zleva doprava se MLM učí předpovídat maskované tokeny na základě obousměrného kontextu. Obousměrná pozornost v MLM umožňuje modelu vidět celou sekvenci současně, což je ideální pro úkoly porozumění textu jako klasifikace nebo zodpovídání otázek.

Technické výzvy a optimalizace: Za kulisami inovací

Vývoj a nasazení pokročilých AI modelů přináší řadu technických problémů, které vyžadují neustálé inovace. Velké modely obsahují biliony parametrů, což klade obrovské nároky na paměť a výpočetní výkon. Problémy jako zaujatost vystavení LLM nebo sladění modalit u VLM vyžadují sofistikovaná řešení.

Efektivita paměti je kritická oblast pro všechny velké modely. Techniky jako kontrolní body gradientů, trénování se smíšenou přesností nebo optimalizátor ZeRO pomáhají rozdělit zátěž napříč několika GPU. Inovativní algoritmy jako FlashAttention a PagedAttention efektivněji pracují s pamětí pro mechanismus pozornosti, což umožňuje zpracovávat delší sekvence a trénovat větší modely. Pro nasazení do produkce se využívá kvantizace, prořezávání a destilace znalostí.

Budoucnost AI: Směr, kterým se ubíráme

Budoucnost umělé inteligence se jeví jako dynamické a mnohostranné pole, kde specializace a hybridní přístupy budou hrát stále důležitější roli. Místo jednoho univerzálního modelu se budeme pravděpodobně setkávat s ekosystémy různých AI nástrojů, z nichž každý bude optimalizován pro konkrétní úkoly.

Retrieval-Augmented Generation (RAG) paradigma silně dominuje praktickým aplikacím AI a jeho význam bude nadále růst. RAG systémy používají modely pro vektorové reprezentace pro vyhledávání relevantních dokumentů a generativní modely pro formulaci odpovědí. Tato hybridní architektura řeší klíčové problémy jako halucinace nebo zastaralá data, protože model má přístup k aktuálním a ověřeným informacím.

Techniky spojování více modalit se stávají stále sofistikovanějšími a budou klíčové pro vytváření AI, která chápe svět komplexněji. Očekáváme vývoj pokročilejších mechanismů křížové pozornosti a nových architektur, které umožní plynulejší interakci mezi různými datovými typy. Integrace se symbolickou AI a logickým uvažováním je dalším důležitým směrem. LAM představují teprve začátek trendu, který se bude snažit překlenout propast mezi neuronovými sítěmi a symbolickou AI.

Výzkumníci také neustále experimentují s novými architektonickými inovacemi. Například Mamba (State Space Models) představuje slibnou alternativu k Transformerům pro zpracování dlouhých sekvencí, jelikož je efektivnější z hlediska paměti a výpočetní náročnosti. RetNet (Retention Networks) je další alternativou zaměřenou na zlepšení efektivity tréninku a inference. Modely se smíšenou hloubkou kombinují vrstvy s různou hloubkou zpracování, což umožňuje efektivněji distribuovat výpočetní zdroje.

Pro většinu lidí bude tato diverzita prakticky neviditelná, jelikož aplikace a služby budou v pozadí používat nejvhodnější modely pro konkrétní úkoly, zatímco uživatelské rozhraní zůstane jednoduché a jednotné. Nicméně porozumění různým typům AI modelů vám pomůže lépe využívat dostupné nástroje a možná i předvídat, jaké nové možnosti se v budoucnu objeví. Svět umělé inteligence je mnohem bohatší, než by se mohlo na první pohled zdát, a jeho diverzita je klíčem k řešení stále složitějších úkolů.